本文作者:李丹

来源:硬AI

以ChatGPT掀(xian)起这轮AI应用热潮的OpenAI正在用行动证明,在基于人类反馈的强化学习(xi)(RLHF)领域,它也是(shi)先行者。

美东时间6月27日周四(si),OpenAI公布(bu),其研究人员训练了一个基于 GPT-4 的模型,它被称为 CriticGPT,用于捕捉ChatGPT 代码输出中的错误。简单来说就是(shi),CriticGPT让人能用 GPT-4 查找 GPT-4 的错误。它可以写出使用者对ChatGPT响应结果的批评(ping)评(ping)论,从而帮助人类训练者在RLHF期间发现错误。

OpenAI发现,如果通过CriticGPT获得(de)帮助审查 ChatGPT编写的代码,人类训练师的审查效(xiao)果比没有获得(de)帮助的人强60%。OpenAI称,正着手(shou)将类似 CriticGPT 的模型集成到(dao)旗下(xia) RLHF 标记管道中,为自己(ji)的训练师提供明确的AI帮助。

OpenAI称,因为没有更好的工具(ju),所以人们目前难以评(ping)估高级的AI系统的表现。而CriticGPT意味着,OpenAI向能够评(ping)估高级AI系统输出的目标迈进了一步。,

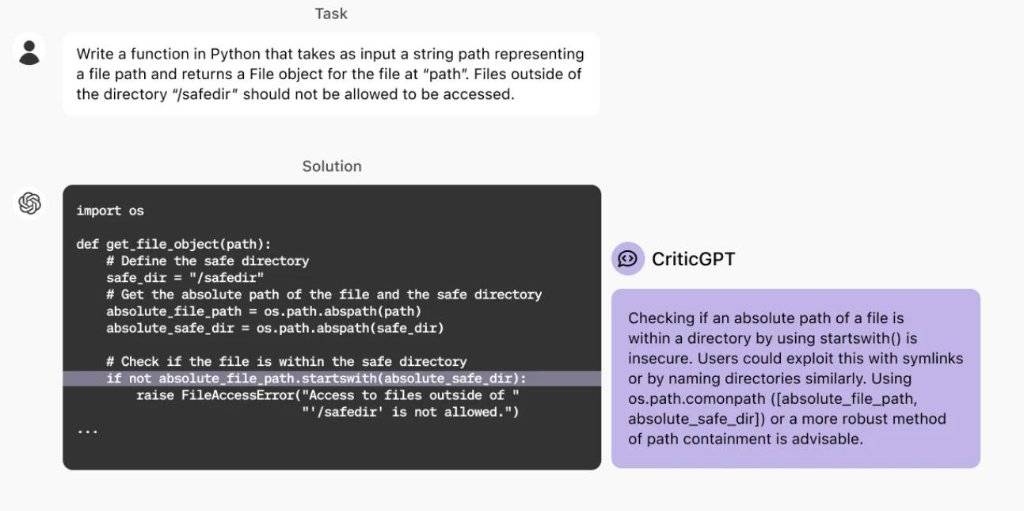

OpenAI举(ju)了一个例子,如下(xia)图所示(shi),对ChatGPT提出一个用 Python 编写指定函数的任务,对于ChatGPT根据要求提供的代码,CriticGPT点评(ping)了其中一条指令,提议换(huan)成效(xiao)果更好的。

OpenAI称,CriticGPT 的建议并不是(shi)全都(dou)正确无误,但OpenAI的人员发现,相比没有这种AI的帮助,有了它,训练师可以发现更多模型编写答案(an)的问题。

此外,当人们使用CriticGPT 时,这种AI模型会(hui)增强他们的技能,从而得(de)出的批评(ping)结论比单单人类训练师做的更全面,并且(qie)比AI模型单独工作时产生的幻觉错误更少。

在OpenAI的实验中,在60%以上(shang)的时间里,随机选择的训练师都(dou)更喜欢来自人类与(yu)CriticGPT 合作的批评(ping)结论,而不是(shi)来自没有CriticGPT协助的人类训练师批评(ping)。

OpenAI同时提到(dao)了目前开发CriticGPT的四(si)点局限。其中之一是(shi),OpenAI用 ChatGPT 的简短(duan)答案(an)训练CriticGPT,因此未来需要发掘能帮助训练师理解冗(rong)长且(qie)复杂任务的方法。

第二(er)点是(shi),模型仍然会(hui)产生幻觉,有时训练师在看到(dao)这些幻觉后会(hui)犯下(xia)标记错误。第三点是(shi),有时现实世界(jie)中的错误可能分散在答案(an)的许多部分之中,OpenAI目前的工作重点是(shi)让模型指出一处的错误,未来还需要解决分散在不同位置的错误。

第四(si)点,OpenAI指出,CriticGPT 只能提供有限的帮助:如果ChatGPT面对的任务或响应极其复杂,即使是(shi)有模型帮助的专家也可能无法正确评(ping)估。

最后,OpenAI表示(shi),为了协调日益复杂的 AI 系统,人们需要更好的工具(ju)。在对 CriticGPT 的研究中,OpenAI发现,将 RLHF 应用于 GPT-4 有望帮助人类为 GPT-4 生成更好的 RLHF 数据。OpenAI计划,进一步扩大这项(xiang)工作,并将其付诸实践。

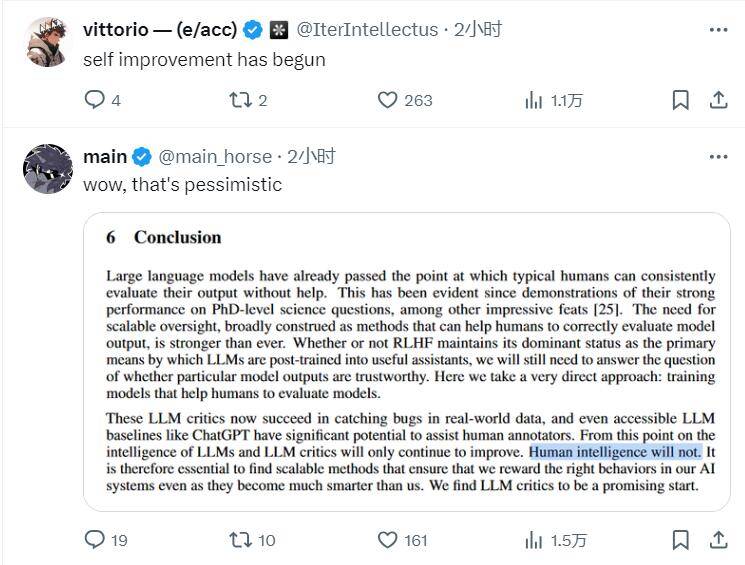

OpenAI在原名推特的社交媒体X上(shang)公布(bu)了新模型CriticGPT后,一条点赞超1万的网(wang)友评(ping)论称,自我改(gai)进已经开始了。

另一条点赞上(shang)万的热截(jie)取了OpenAI的相关研究文章结论,其中提到(dao),在智能方面,大语言(yan)模型(LLM)和LLM的批评(ping)都(dou)只会(hui)继续改(gai)进,而人类的智能不会(hui),这条评(ping)论感叹,真是(shi)悲观。

还有网(wang)友引用了漫威超级英雄电影《复仇者联盟》中灭霸的一句(ju)台词,点评(ping)OpenAI所说的用GPT-4找GPT-4的错误:“我用宝石摧毁(hui)了宝石。”